Мир технологий всегда был местом смелых прогнозов, но диалог с Кевином Вейлом, директором по продуктам (CPO) OpenAI, выделяется даже на этом фоне. Кевин Вейл из OpenAI уверен, что AGI уже на пороге — и появится в текущем году. Представьте, что ваш коллега по команде — не человек. Он не пьёт кофе, не присылает мемчики в пятницу и… обходит вас в любимых видеоиграх с разгромным счетом. Звучит как сюжет Black Mirror? Для Кевина Вейла это не фантастика. В ближайшие несколько месяцев, по его словам, ИИ превзойдёт человека в программировании. Недавнее интервью открывает нам не только технические перспективы, но и ставит фундаментальные вопросы о будущем человечества в эпоху стремительного развития ИИ.

Чек-лист апокалипсиса для IT-профессий прилагается:

-

Экспоненциальное падение стоимости ИИ-интеллекта — в 10 раз ежегодно (закон Мура плачет в углу).

-

Робототехника как «физическое воплощение AGI» — когда ошибка в коде будет не багом, а ударом кулаком по столу.

-

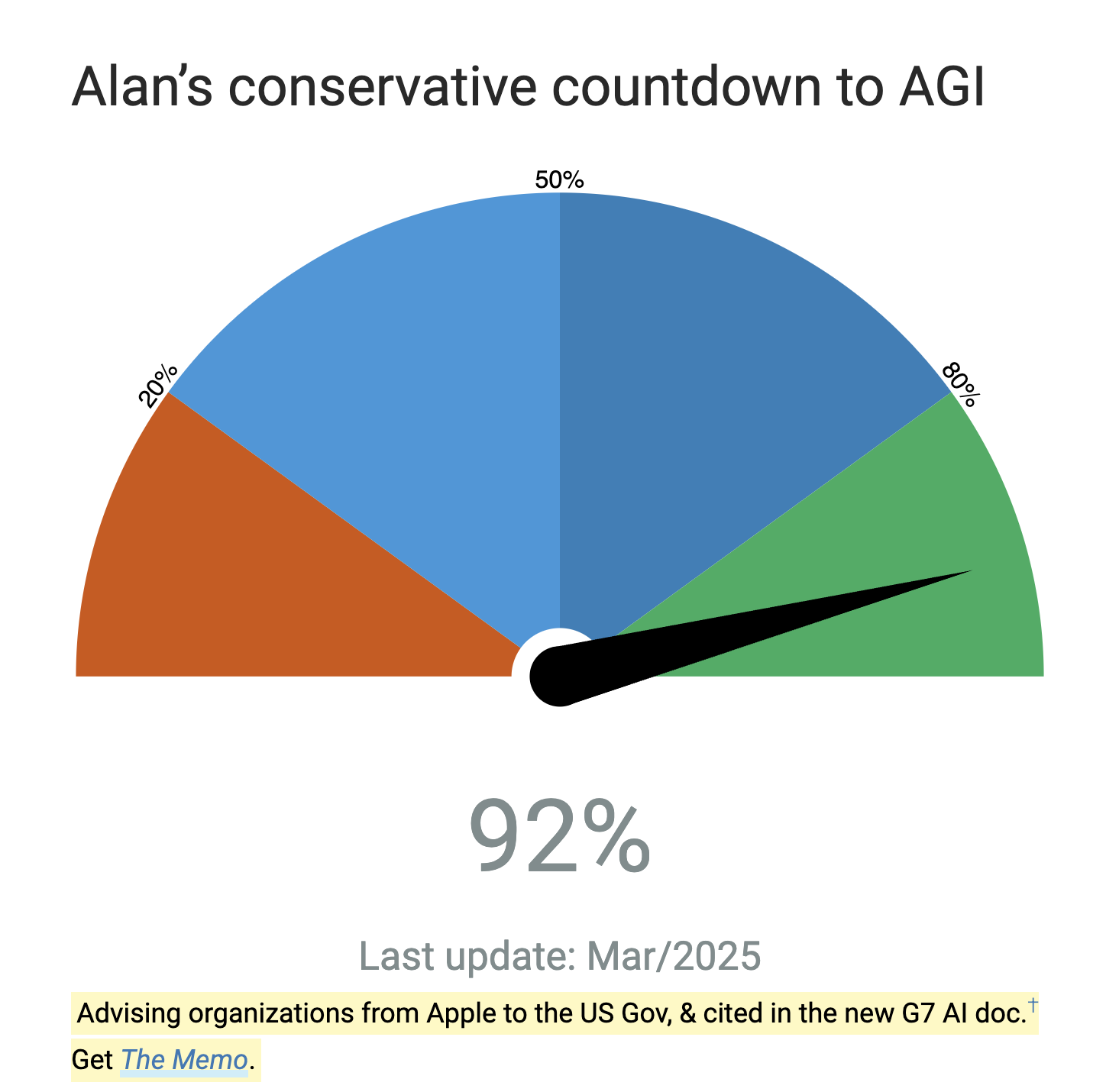

ИИ-репетиторы и AGI-счётчик, который тикает, пока вы читаете и чем-то напоминает обратный отсчёт до старта SkyNet.

Код как последний рубеж

Наиболее тревожный сигнал в интервью — категоричный прогноз Вейла о сроках автоматизации программирования. В отличие от осторожной оценки Anthropic (2026-2027 год), представитель OpenAI безапелляционно заявляет:

«Я думаю, что 2025 год станет годом, когда ИИ превзойдет людей в соревновательном программировании. Навсегда».

Вейл подкрепляет свой прогноз конкретной эволюцией моделей:

-

O1 Preview — уровень «миллионного лучшего» программиста

-

O1 при запуске — уровень «тысячного лучшего» инженера

-

O3 (в разработке) — 175-е место среди программистов мира

-

Последующие модели — еще Быстрее. Выше. Сильнее…

Похоже на заявление о приближающемся переломном моменте, сравнимом с тем, когда компьютеры превзошли людей в математических вычислениях или шахматах. Но у этого перехода совершенно иной масштаб последствий — ведь программирование до сих пор считалось одним из последних рубежей творческой и технической исключительности человека.

Дихотомия масштабирования

Технический дискурс об архитектуре моделей ИИ редко попадает в широкое обсуждение, однако именно здесь скрыты ключевые тенденции развития технологии. Вейл раскрывает два принципиально разных пути усиления интеллектуальных возможностей:

-

Экстенсивное развитие (pre-training) — наращивание объема предобучения, что приводит к:

-

Улучшению «soft skills» моделей

-

Расширению фоновых знаний и общей эрудиции

-

Более естественному стилю общения

-

-

Интенсивное развитие (RL) — усиление способности ИИ-модели к рассуждению через:

-

Развитие аналитических способностей

-

Улучшение решения сложных задач

Линейка GPT-моделей (GPT-3, GPT-3.5, GPT-4, GPT-4.5) делает ставку на масштабирование предобучения — увеличение количества параметров и объема обучающих данных. Как отмечает Вейл:

“4.5 пишет действительно хорошо, способен улавливать нюансы в том, что я сказал, способен улавливать пограничные случаи… есть что-то в его способе письма, что просто ощущается по-человечески.”

Этот подход приводит к появлению моделей с выдающимися коммуникативными способностями, расширенными знаниями о мире и более естественным, контекстуально адаптивным взаимодействием с пользователем.

С другой стороны, серия O (O1 Preview, O1, готовящаяся к выпуску O3) фокусируется на усилении способности к рассуждению через специализированные алгоритмы обучения:

“O1 Preview был намного лучше как модель для кодирования, потому что рассуждение важно при написании кода… вам нужен определенный уровень рассуждения, некоторая способность разбивать проблему на более мелкие проблемы, формировать гипотезы, подтверждать или опровергать эти гипотезы.”

Модели этой серии демонстрируют впечатляющие результаты в задачах, требующих многоэтапных рассуждений, логического анализа и декомпозиции сложных проблем на подзадачи.

Важная информация, раскрытая Вейлом в интервью, касается планов OpenAI по объединению этих двух подходов в GPT-5:

“У нас была эта бифуркация… исторически у нас были все модели GPT… и мы добились этого прорыва в прошлом году с рассуждениями… Сейчас, когда мы познакомились с этими моделями рассуждения, мы учим их использовать все инструменты, которые может использовать серия GPT… и теперь O-серия и GPT-серия начинают обладать одинаковыми возможностями, что дает нам возможность объединить их, и это то, что мы планируем сделать с GPT-5.”

Этот технологический синтез представляет собой не просто инкрементальное улучшение, а потенциальный квантовый скачок в возможностях ИИ-систем.

“Мы оптимизируем для скорости, оптимизируем для предоставления этих новых инструментов в руки людей, чтобы они могли делать больше удивительных вещей быстрее”, – отметил Вейл.

Вопрос лишь в том, готовы ли мы как общество к последствиям этой оптимизации.

Экспоненциальное снижение стоимости интеллекта

Среди многочисленных технологических прогнозов, озвученных в интервью с Кевином Вейлом, особого внимания заслуживает его заявление об экономике искусственного интеллекта. Статистика сигнализирует о фундаментальном сдвиге:

«..если взять определенный уровень интеллекта в качестве ориентира, стоимость этого интеллекта снижается в 10 раз каждый год».

Для контекста: закон Мура, который определял технологический прогресс последние 60 лет, — это удвоение вычислительной мощности каждые 18 месяцев. То есть новый темп развития в 5-6 раз быстрее.

«И, конечно, интеллект не остается постоянным, он драматически увеличивается одновременно со снижением затрат», – добавляет Кевин Вейл.

При таких темпах мы наблюдаем фундаментальную трансформацию:

-

Интеллектуальные возможности растут экспоненциально

-

Стоимость доступа к ним падает быстро

-

Временной горизонт прогнозирования сжимается с лет до месяцев

Это означает, что мы наблюдаем не просто удешевление существующих возможностей, а двойную экспоненту: экспоненциальное снижение стоимости доступа к экспоненциально растущим возможностям. Такое сочетание трендов не имеет исторических прецедентов в технологическом развитии.

Каскад экономических и социальных трансформаций на подходе:

-

Радикальное снижение стоимости означает беспрецедентную демократизацию доступа к продвинутым интеллектуальным инструментам. Возможности, которые сегодня доступны только крупным корпорациям или исследовательским центрам, через несколько лет могут стать доступными для малого бизнеса и даже индивидуальных пользователей.

-

Традиционные циклы стратегического планирования в управлении измеряются годами. Однако скорость изменений, описанная Вейлом, сокращает эти горизонты: продуктовые циклы сжимаются с лет до кварталов или месяцев, образовательные программы устаревают прежде, чем выпускники получают дипломы, а регуляторные механизмы не успевают адаптироваться к технологической реальности.

-

Исторически экономическая ценность интеллектуального труда определялась его редкостью и сложностью воспроизведения. Десятикратное ежегодное снижение стоимости ИИ-вычислений создает фундаментальную инверсию этой модели: рутинная интеллектуальная работа стремительно обесценивается, формальное образование может потерять свою ценность на рынке труда, профессиональная экспертиза (казалось бы) становится одновременно более доступной и менее ценной.

За экономическими и технологическими трансформациями скрываются более глубокие, экзистенциальные вопросы:

-

Если уникальные когнитивные навыки, на развитие которых профессионал потратил десятилетия, могут быть воспроизведены или даже превзойдены ИИ-системой — что это означает для профессиональной идентичности? Как переопределить ценность своего труда в мире, где его уникальность стремительно размывается?

-

Классические образовательные траектории построены на предположении о долгосрочной ценности приобретаемых навыков и знаний. Если стоимость доступа к этим навыкам и знаниям падает экспоненциально — как должна измениться сама концепция образования?

-

В экономической системе, где машинный интеллект стремительно дешевеет, возникает фундаментальный вопрос о новых основаниях ценности человеческого интеллекта.

Потребуется выработка новых стратегических приоритетов на всех уровнях — от личного до глобального.

-

На индивидуальном уровне это означает фокус не на накоплении специфических знаний и навыков, а на развитии метакогнитивных способностей, позволяющих эффективно взаимодействовать с постоянно эволюционирующими ИИ-инструментами.

-

На организационном уровне – переход от жестких иерархических структур к адаптивным экосистемам, способным быстро интегрировать новые технологические возможности и переопределять бизнес-модели.

-

На государственном уровне потребуется разработка новых подходов к регулированию, образованию и социальной защите, учитывающих беспрецедентную скорость технологических изменений.

Deep Research: за кулисами “момента AGI”

Интересна дискуссия о продукте Deep Research, который, по словам Вейла, вызывает «моменты ощущения AGI» с мурашками по коже.

«Deep Research — лучший продукт, который мы запустили после самого ChatGPT», — утверждает он.

Но что конкретно стоит за этими метафорами?

-

Выполнение когнитивных задач, непосильных для обычного человека — например, создание 15-страничного отчета о мюонных коллайдерах за 20 минут.

-

Минимальные галлюцинации при выдаче конкретных фактов (вот это интересно!)

-

Глубокий анализ с учетом нюансов информации. Способность извлекать очень конкретные данные из массивов информации. В примере Вейла упоминается получение точных сведений о количестве людей, задействованных в создании AAA-игр, например.

Что принципиально важно: происходит качественный сдвиг в позиционировании ИИ — от “экономии времени” к “выполнению невозможного”. Как отмечает сам Вейл:

“Deep Research не просто экономит мне 5-10 минут… это фундаментально то, что я сам не смог бы сделать”.

Технологическая основа vs. когнитивная иллюзия

Возникает закономерный вопрос: имеем ли мы дело с фундаментальным технологическим прорывом или с исключительно продуманным интерфейсом, создающим когнитивную иллюзию «сверхинтеллекта»?

Возможно, мы наблюдаем не столько технологический прорыв, сколько хорошо продуманный UX, создающий иллюзию сверхинтеллекта. Напоминает классический эффект «волшебства технологий» (термин когнитивной психологии)— когда продукт кажется магическим просто потому, что пользователь не видит всей механики его работы.

При этом нельзя не отметить социальный аспект: если Deep Research действительно способен извлекать инсайты из огромных массивов информации, доступ к такому инструменту становится серьезным конкурентным преимуществом, усиливающим информационное неравенство (подписчики сервиса получают доступ к уникальным данным и аналитике). Как следствие – формируется новый когнитивный разрыв в обществе — между теми, кто использует такие инструменты, и теми, кто полагается на традиционные методы исследования. Да и меняется само определение экспертизы — когда экспертное мнение может быть сгенерировано инструментом без специализированных знаний у пользователя (ой!). Отмечу, что Deep Research работает не просто с параметрами и предобучением, но активно взаимодействует с актуальными данными в реальном времени, что делает его потенциально более опасным с точки зрения создания и распространения дезинформации.

Робототехника: “воплощенный интеллект” и экзистенциальный рубеж

«Мы начинаем смотреть в сторону робототехники… Для меня это следующий шаг: сначала вы осваиваете цифровой мир, а затем, после того как у вас есть AGI, которое помогает нам делать всевозможные вещи в цифровом мире, следующее очевидное место для этого — робототехника и воздействие на реальный мир».

Заявления Кевина Вейла относительно стратегического интереса OpenAI к робототехнике сигнализируют о начале нового этапа в эволюции ИИ-технологий. Кевин Вейл представляет робототехнику не как параллельное направление исследований, а как логическое продолжение работы над AGI. Утверждение «если мы хотим быть компанией, которой мы хотим быть, нам нужно играть в обоих мирах» демонстрирует понимание, что лидерство в ИИ невозможно без “присутствия в физическом мире”.

Этот вектор развития открывает принципиально новый уровень рисков:

-

Перенос потенциальных ошибок и смещений ИИ в физический мир. Если в цифровом пространстве ошибки ИИ могут приводить к неверным рекомендациям или некорректной обработке информации, то в контексте робототехники те же ошибки могут иметь весьма “неприятные” физические последствия для людей. Вроде “не рассчитал силу”, к примеру.

-

Интеграция ИИ в физические устройства радикально расширяет диапозон кибератак. Подготовка идет со стороны атакующих полным ходом.

-

История технологий показывает, что любая достаточно продвинутая технология неизбежно находит военное применение. Конвергенция продвинутого ИИ и робототехники создает фундамент для разработки автономных боевых систем нового поколения. В статье “Боевые действия с использованием дронов, бактериальные сражения и искусственный интеллект на службе противников” о том, как видят войны будущего бизнесмены и футурологи.

-

Непредсказуемые социальные эффекты от массовой автоматизации физического труда.

Вейл говорит о робототехнике не как о возможном направлении развития, требующем общественного консенсуса, а как о технологической неизбежности:

«…роботы будут большим делом, и мы хотим обеспечить их [возможности] для множества других компаний…».

Технологический императив, которым руководствуются компании, работающие над ИИ, не оставляет сомнений, что эта трансформация произойдет независимо от готовности общества к ее последствиям (читаем — «нас уведомили»). При этом ускоренное развитие робототехники происходит в условиях отсутствия глобальных регуляторных рамок для автономных систем и неравномерного доступа к технологиям между различными странами и социальными группами.

ИИ-наставники и будущее образования

В потоке технологических прогнозов, прозвучавших в интервью Кевина Вейла, особого внимания заслуживает его видение будущего образования.

«Я хочу, чтобы каждый ребенок рос с персонализированным репетитором… и я не знаю, почему это еще не существует сегодня… это кажется одной из самых ценных вещей, которые можно сделать, чтобы значимо изменить темпы перемен в мире и качество жизни во всем мире… Каждый результат, который я когда-либо видел, каждое исследование, которое я когда-либо видел, говорит, что дети с обычным образованием плюс персонализированный репетитор на стандартные отклонения превосходят детей, которые получают только обычное образование».

Ключевым преимуществом ИИ-систем, как отмечает сам Вейл, является их «бесконечное терпение» — способность объяснять сложные концепции без раздражения:

«…ценность в том, чтобы иметь индивидуальный опыт с бесконечно терпеливым ИИ, который может двигаться в любом темпе, который вы хотите, вы можете спрашивать что угодно, вам не нужно чувствовать себя глупо».

Действительно, психологическая безопасность – важный фактор эффективного обучения. Отсутствие страха задать “глупый вопрос” или двигаться в собственном темпе может существенно повысить эффективность обучения. Однако это преимущество имеет и обратную сторону, как мне кажется. Исторически образование было не только передачей знаний, но и важной частью процесса социализации, где “бесконечное терпение” — редкость.

За благородной целью скрывается еще один фундаментальный вопрос: что станет с «самостоятельным» мышлением людей в мире, где каждый имеет доступ к искусственному интеллекту, намного превосходящий человеческий? Сценарии, которые потребуют тщательного анализа:

-

Развитие зависимости от ИИ-подсказок с ранних лет

-

Атрофия способности к самостоятельному поиску решений

-

Стандартизация мышления под алгоритмы ИИ

-

Потеря культурного разнообразия познавательных подходов

Вейл сравнивает этот “переход” с появлением калькуляторов, избавивших нас от необходимости производить длительные вычисления вручную. Но это сравнение некорректно: калькулятор автоматизировал механическую операцию, а ИИ-репетитор претендует на роль наставника в формировании мышления.

Интересно. Когнитивные риски ИИ подтверждаются исследованиями: учёные из Microsoft и Университета Карнеги—Меллона обнаружили, что активное использование ИИ-инструментов постепенно снижает способность пользователей к критическому мышлению, формируя паттерн зависимости от автоматизированных решений.

Парадоксально, но даже в сфере разработки ПО, где ИИ позиционируется как помощник, результаты оказались неоднозначными. Так, эксперимент компании Uplevel с участием 800 программистов показал, что применение ИИ для генерации кода не только не повысило их продуктивность, но и привело к увеличению числа ошибок. Более того, ожидаемого снижения уровня эмоционального выгорания не произошло. Участники жаловались, что анализ ИИ-сгенерированных фрагментов на предмет ошибок требует больше времени и усилий, чем самостоятельное написание кода с нуля. Это заставляет многих разработчиков отказываться от «искусственного» кода в пользу ручного редактирования, что сводит на нет потенциальные преимущества технологии.

Между технооптимизмом и глобальными рисками

С одной стороны, мы видим впечатляющий технический прогресс, открывающий невероятные возможности. С другой — очевидный дефицит глубокого осмысления социальных, этических и экзистенциальных последствий. Мы вступаем в эпоху, когда технологический прогресс измеряется не годами, а месяцами и даже неделями. Это немного «очень быстро», как вы думаете?

Есть подозрение, что традиционные механизмы адаптации общества к новым технологиям катастрофически не будут успевать за темпами изменений, а разрыв между технологическими возможностями и этическими ограничениями продолжить расти. Компании, разрабатывающие ИИ, оказались в классической ситуации дилеммы заключенного, где конкурентное давление вынуждает их ускорять разработку, даже понимая потенциальные риски.

В этих условиях общество и регуляторы оказываются в роли догоняющих, что создает идеальные условия для непредвиденных системных кризисов. Время стратегического осмысления будущего сжимается также экспоненциально, как снижается стоимость искусственного интеллекта.

Выводы..

За Вами.

Автор: Anna22K