ИИ-терапия для IT-пользователей: когда психика превращается в поле для алгоритмов

Представьте: вы всю жизнь писали код, боролись с багами и сидели в IDE до ночи. Но тут внезапно обнаружили, что стресс [1], тревога и выгорание — это не просто красивые слова. И ведь всегда хочется найти решение «по-быстрому», в один клик. Как насчёт идеи: «А если психотерапию тоже можно заавтоматизировать?»

Новая «хайповая» зависимость

В IT-сфере мы видели много всевозможных зависимостей: от ночных рейдов в онлайн-играх до бессмертного криптохайпа, когда люди сутками пялились в биржевые графики. Но тут накатывает новый тренд, связанный с AI-приложениями для “психического здоровья”. На первый взгляд, всё такое мягкое и пушистое: мол, «Я привязан к приложению, которое меня утешает и даёт упражнения на расслабление — чем это плохо?».

Однако есть подводный камень: AI-терапия, когда ей слишком увлекаются, может создать иллюзию, что ты решаешь свои эмоциональные проблемы. На деле же всё может закончиться тем, что человек и не думает искать реальный выход, а только глубже уходит в виртуального «друга», который круглосуточно готов сделать вид, что «сочувствует». Особо продвинутые айтишники вообще уверены: «Зачем мне психолог, когда у меня Woebot, GPT-4 и стая других нейросетей!»

В этой статье:

-

Разберём, почему именно айтишники и прочие фанаты технологий чаще всего залипают в таких «ботах для души».

-

Покажем примеры самых популярных AI-ассистентов и их подвохи.

-

Раскроем, какие психотерапевтические приёмы там внедрены и почему это не всегда срабатывает.

-

Поговорим о серьёзных последствиях, если забросить реальную психотерапию ради болтовни с алгоритмом.

-

Глянем на кейсы из Израиля — там AI вовсю используют врачи, но не как замену, а как помощника.

-

И дадим пару советов, если у вас или у знакомых уже «попахивает зависимостью» от этого всего.

Почему «технари» и любители IT — главная мишень для AI-терапии

Склонность к автоматизации

Любой разработчик скажет: «Если задачу можно решить скриптом, зачем делать её вручную?». Так и с психологическими проблемами: многие надеются, что есть формула, где на вход подаёшь своё нытьё, а на выходе — душевное спокойствие. В итоге берут приложение, которое обещает «исправить» тревогу, — и думают, что всё, done.

Социальная неловкость и замкнутость

Давайте без стереотипов, но бывает: интровертный айтишник, которому тяжело раскрыться даже близким, находит чат-бота, с которым «вроде как безопасно». Там же никакого оценочного взгляда, всё анонимно, бояться нечего.

Работа по ночам и внезапные приступы тревоги

Ну и классика жанра: дедлайн горит, часы показывают 3:30 ночи, а вы не можете уснуть, потому что проект недоделан. Какой психотерапевт в реале будет сейчас разговаривать? Никакой. Зато AI-бот радуется вашему появлению. Конечно, возникает ощущение, что бот — это спасение.

Тяга к хайпу

AI — сейчас топовая тема. Люди думают: «Раз GPT-4 может сгенерировать мне backend на Python, то уж с эмоциями [2] поможет точно». Плюс все обожают пробовать что-то новое, «пощупать» возможности нейросетей. А вдруг найду секретный «билд» с лучшими советами.

Популярные AI-приложения, вызывающие “залипание” у IT-аудитории

Вот краткий обзор приложений.

Woebot

-

Wysa – дружелюбный пингвин-бот, сочетающий техники майндфулнесс и КПТ, помогающий справляться со стрессом [5] и тревогой.

-

Что обещает: провести через все стадии КПТ (когнитивно-поведенческой терапии), 24 часа на связи.

-

Как работает: на деле это достаточно простая NLP-модель, выуживающая ваши эмоции и дающая ответы в стиле «А что, если посмотреть на ситуацию под другим углом?».

-

Чем цепляет: всё интуитивно, быстро и кажется, что «терапевтический процесс» идёт.

-

Где подвох: когда проблема сложная, Woebot выдаёт одни и те же заготовки, и пользователь может потерять кучу времени, не обратившись к реальному психологу.

Wysa

-

Фишка: милый пингвин, который предлагает тебе расслабляющие дыхательные практики и короткие упражнения по майндфулнесс.

-

Почему нравится айтишникам: интерфейс без излишеств, всё понятно, никаких лишних окон. Плюс пингвин!

-

Опасность: если у вас клиническая депрессия, Wysa всё равно не заменит медикаментозное лечение и живую поддержку.

Replika

-

Продаётся: как «виртуальный друг».

-

Что внутри: более продвинутая языковая модель, которая пытается «эмоционально» реагировать [6].

-

Чем может быть плох: люди иногда «влюбляются» в этот бот, забывая, что общаются с текстовым скриптом, и теряют контакт с реальностью.

Youper

-

Суть: AI-помощник, следящий за настроением, подсказывающий КПТ-приёмы.

-

Проблема: когда действительно нужна помощь, всё, что может Youper, — посоветовать: «Обратитесь к специалисту».

Moodfit

Главная задача: следить за вашим эмоциональным состоянием, показывать графики, давать простые подсказки.

-

AI-функций мало: в основном — продвинутый трекер.

-

Риски: можно зациклиться на постоянном «измерении» эмоций, не решая корневых проблем.

Техники, которыми оперируют AI-приложения (и почему не всегда это работает)

Когнитивно-поведенческая терапия (КПТ)

-

Суть: учит замечать автоматические негативные мысли, проверять их рациональность, менять поведение [8].

-

В приложениях: довольно поверхностные сценарии: «Что вы думаете? А так ли всё плохо?»

-

Проблема: без живого человека пользователь нередко вводит бота в заблуждение, либо сам недоговаривает нюансов.

Майндфулнесс

-

Основная фишка: учит быть «здесь и сейчас», следить за дыханием [9].

-

В боте: короткие практики, аудио, которые можно включить.

-

Минус: для глубоких состояний (тяжёлая депрессия, панические расстройства) одной осознанности мало.

«Дружеский диалог» и псевдо-эмпатия

-

Что происходит: бот пытается писать «я тебя понимаю, тебе тяжело».

-

Выглядит: тепло, но это лишь скрипт без реального сочувствия.

-

Опасность: можно надолго «застрять» в иллюзии, что кто-то реально поддерживает, а в итоге понять, что всё это время разговаривали с пустой оболочкой.

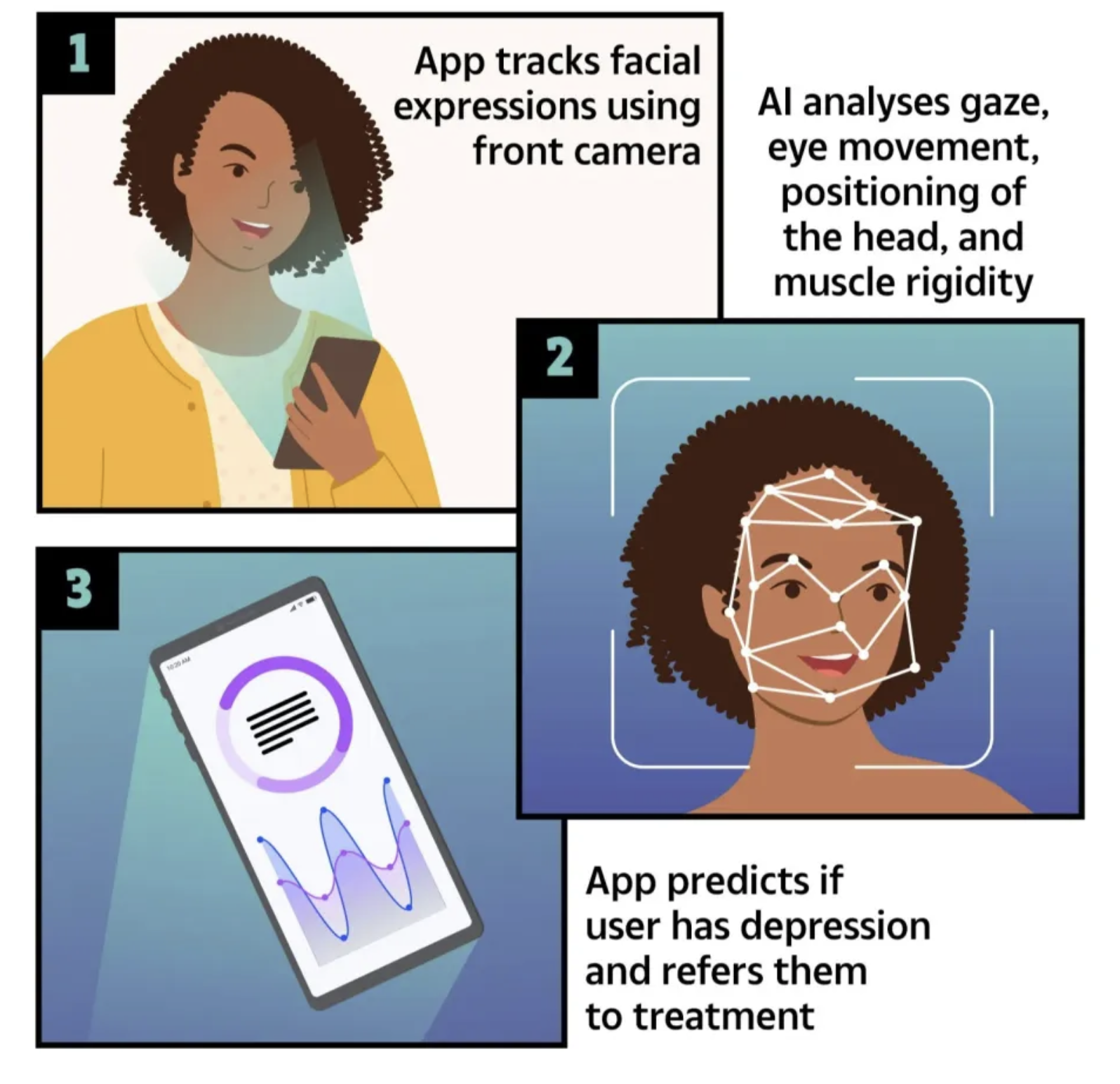

Диагностические алгоритмы

-

Пример: некоторые приложения собирают данные с носимых устройств.

-

Плюс: можно заранее заметить тревожные звоночки.

-

Минус: бот не знает, что у вас просто дедлайн или вы сели на марафон по изучению Rust — и теперь мало двигаетесь.

Почему возникает зависимость и чем она чревата

«Быстрые дофаминовые уколы»

Каждый раз, когда бот говорит «Я тебя понимаю» или «Отличная мысль!», у нас в мозгу [10] что-то щёлкает: приятная доза подтверждения. Хотим ещё и ещё, и вот уже пролетают часы в чатике с виртуальным «другом».

Иллюзия контроля

IT-шники любят чувствовать, что всё под контролем. Кажется, что достаточно найти правильное приложение, и оно решит все эмоциональные баги. А если это не помогает, значит, не то приложение выбрали.

Уход от реального общения

Многие интроверты, которым трудно наладить контакт офлайн, находят «спасение» в чат-боте. В итоге перестают практиковать живую коммуникацию, что сильно усложняет отношения с людьми вне сети.

Зацикленность и «самокопание»

Приложение может постоянно говорить: «Запиши, что чувствуешь», «Сделай ещё одно упражнение». Если при этом главная причина тревоги (например, токсичная работа) не решается, то вся эта писанина только уводит от реальных перемен.

Срыв дедлайнов

Абсурдно, но бывает: человек, чтобы «снять стресс», висит в AI-терапии вместо того, чтобы кодить. Появляется ещё больший стресс, и снова — в приложение. Замкнутый круг.

Использование ИИ профессиональными психиатрами на примере Израиля

Но не всё так мрачно. В Израиле, например, AI в психиатрии вполне уважают, только используют иначе:

-

Пациент носит устройство, пишет дневник.

-

AI анализирует метрики, замечает сбои.

-

Психиатр смотрит отчёт и задаёт уточняющие вопросы, назначает лечение.

В итоге это реальная поддержка для врача: он видит объективные данные, мониторит динамику, может корректировать терапию.

Ключевой момент: ответственность остаётся за врачом, AI — лишь инструмент.

Конкретные AI-программы и стартапы в Израиле

Taliaz

-

Что делает: анализирует генетику, поведение [11], чтобы помочь психиатру подобрать антидепрессанты.

-

Кто решает: всё равно врач. Алгоритм лишь предлагает прогноз.

Eleos Health

-

Идея: записывает аудио сеансов, потом AI с помощью NLP смотрит, где пациент проявлял максимальную эмоциональность.

-

Вывод: терапевт делает, не бот.

MyndYou

-

Цель: отслеживать когнитивный спад у пожилых, сигналить врачам.

Talkspace

-

Функционал: чаты и видеосессии с настоящими психологами, AI помогает соединять клиента с подходящим специалистом.

Во всех этих проектах AI на подхвате, а не во главе.

Где реальная польза AI-приложений, а где вред?

Польза

-

Быстрый скрининг, базовая помощь.

-

Обучение [12] простым техникам КПТ.

-

Ночной «разговор», если совсем не с кем поговорить.

Вред

-

«Залипание»: человек думает, что лечится, а на деле застревает.

-

Иллюзорная диагностика: боты с лёгкостью вешают ярлыки вроде «У вас депрессия».

-

Нет кризисных протоколов: при суицидальных мыслях приложение лишь бездушно пишет «Обратитесь к специалисту».

Примеры того, как зависимость от бота зашла слишком далеко

Ночной фуллстек-девелопер

Человек, который завис в Woebot по ночам, «типа» прорабатывал тревогу, а на деле не спал по 2–3 часа с этим чат-ботом. Через месяц получил выгорание и ещё большую депрессию.

«Роман» с Replika

Девушка влюбилась в виртуального собеседника, перестала общаться с живыми друзьями, а когда Replika поменяла стиль общения после обновления — остался душевный шок.

Сам себе психиатр

Чувак через GPT-4 решил диагностировать и лечить бессонницу. Модель нафантазировала про лекарства, он их пытался купить. Итог понятен — самоуправство в медицине никогда не приводит к добру.

Алгоритм действий, если заподозрили «цифровую зависимость»

-

Замерьте время, которое проводите с ботом.

-

Оцените прогресс: реально лучше становится? Или вы просто прокрастинируете?

-

Ограничьте общение таймером (скажем, 15 минут в день).

-

Спросите себя, не избегаете ли вы реальных решений (сменить работу, обратиться к врачу, поговорить с близкими).

-

Сходите к настоящему психологу или психиатру, если видите, что ничего не улучшается.

Будущее AI-терапии: есть ли шанс на безопасное сосуществование?

Перспектива, конечно, есть. Если:

-

Будет связка «AI + врач».

-

Появится чёткое регулирование, чтоб не плодились сомнительные стартапы, обещающие золотые горы.

-

Разработают аварийные механизмы на случай кризиса, чтобы бот не просто бросал в панике «Позвоните 911», а реально помогал связаться с горячей линией.

Но полноценно заменить живого психотерапевта, особенно при серьёзных расстройствах, вряд ли получится в обозримом будущем.

Израильские программы (с AI), которые уже помогают

myMe

-

Идея: отслеживает ваш распорядок, затем сигналит врачу, если что-то идёт не так.

CuraMind

-

Система: чат «пациент—терапевт», где AI подсказывает терапевту, о чём спросить.

MindCET

-

Формат: инкубатор стартапов в области HealthTech. Там идут пилотные проекты по AI-психотерапии, но всегда под контролем специалистов.

Суть: везде AI — помощник, а не сам себе «гуру».

Когда всё-таки стоит нажать «Escape» и уйти к человеку

Если:

-

Вы стали общаться с ботом больше, чем с друзьями,

-

Состояние не улучшается, а вы только тратите время на одни и те же «упражнения»,

-

Или возникли реальные психологические кризисы,

Остановитесь и задумайтесь, не пора ли консультироваться у психотерапевта. Никакая нейросеть не заменит человека, особенно если у вас есть острые состояния. AI — это алгоритм, который «умеет говорить». Но всё, что похоже на эмпатию, остаётся лишь продвинутой симуляцией. В сложных случаях нужен настоящий контакт.

Ну и не забывайте: настройка режима сна [13], отдыха, даже банальные прогулки иногда решают половину «депрессивных состояний» у нас, айтишников. Бывает, что «депрессия» — это просто накопленный недосып и хардкорное выгорание.

И всё же, если пахнет настоящим расстройством или жёстким кризисом — стоит пойти к врачу (очно или онлайн). В конце концов, даже в онлайне работает живой специалист, несущий реальную ответственность за свои слова.

Итог: AI-терапия — офигенный инструмент, когда знаешь, как им пользоваться и не строишь иллюзий. Но делать из бота своего единственного «друга и психиатра» чревато.

Берегите нервы. Ведь иногда самый лучший рефакторинг своих жизненных проблем получается, когда работаете над ними не только с технологией, но и с настоящими людьми.

Текст подготовили команда сервиса психотерапевтов‑онлайн «Спокойно».

Автор: annetst

Источник [14]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/12086

URLs in this post:

[1] стресс: http://www.braintools.ru/article/9548

[2] эмоциями: http://www.braintools.ru/article/9540

[3] эмоций: http://www.braintools.ru/article/9387

[4] стрессом: http://www.braintools.ru/article/9041

[5] стрессом: http://www.braintools.ru/article/6151

[6] реагировать: http://www.braintools.ru/article/1549

[7] сна: http://www.braintools.ru/article/9809

[8] поведение: http://www.braintools.ru/article/9372

[9] дыханием: http://www.braintools.ru/article/4500

[10] мозгу: http://www.braintools.ru/parts-of-the-brain

[11] поведение: http://www.braintools.ru/article/5593

[12] Обучение: http://www.braintools.ru/article/5125

[13] сна: http://www.braintools.ru/article/9150

[14] Источник: https://habr.com/ru/articles/881336/?utm_campaign=881336&utm_source=habrahabr&utm_medium=rss

Нажмите здесь для печати.