Всем привет! Я Федор Горбунов, руководитель направления машинного обучения в Doubletapp. Сегодня поговорим о том, какие значимые для искусственного интеллекта события произошли в 2024 году и попробуем спрогнозировать вектор развития отрасли в будущем.

В мае OpenAI представили модель gpt-4o, а Google — Gemini 1.5 с похожими возможностями

Что нового умеют новые модели? «О» в названии gpt-4о означает «омнимодальность».

Это значит, что модель может принимать текст, изображения, аудио и видео в одном запросе и анализировать их вместе.

Например, вы можете отправить изображение, а текстом написать вопрос: «Что тут изображено?» или «Какой текст написан на этой фотографии?». Это все доступно в бесплатной версии, а с подпиской — больше.

Благодаря тому, что аудио и видео передается напрямую, без конвертации в текст, у модели очень низкие задержки, и это позволяет, например, разговаривать с моделью в реальном времени с видеосвязью. Можно перебивать её или задавать уточняющие вопросы. Модель видит, что происходит на видео, и может отвечать на вопросы, связанные с окружением. Проще говоря, модели можно позвонить, как другу, показать обстановку вокруг и задать вопросы.

Также вы можете пошарить ей экран, показать интерфейс приложения и попросить помочь что-то в нем сделать.

Омнимодальность выводит взаимодействие с искусственным интеллектом на новый уровень, делая его более универсальным. Это шаг вперед в возможности применения искусственного интеллекта в реальной жизни — от помощи в работе с софтом до полноценного визуального анализа окружающего мира.

Для пользователей это означает удобное использование ИИ без необходимости переключаться между инструментами: распознавание текста, переводы, взаимодействие с интерфейсами и даже решение бытовых задач. Для бизнеса это упрощение процессов — там, где раньше требовалась интеграция нескольких узкоспециализированных решений, теперь всё можно реализовать в одной модели с меньшими затратами на разработку и поддержку.

LLM все чаще могут решать задачи, связанные с компьютерным зрением

Gemeni 2.0 от Google умеет находить объекты на изображении по текстовому запросу.

Но узкоспециализированные модели, которые умеют только в компьютерное зрение, все равно остаются востребованными, так как они работают быстрее и часто нужна работа локально на устройстве пользователя, иногда в реалтайме.

Например, мы недавно делали проект для социальной сети автолюбителей. Там для подтверждения того, что тачка твоя, нужно просто навести камеру телефона на машину с открытыми дверьми так, чтобы был виден ее номер. Моделька работает локально на устройстве и в реальном времени через камеру определяет, открыты ли двери, распознает госномер.

В сентябре OpenAI представили o1

Это переход к моделям, которые дополнительно обучаются решению задач через реинфорсмент лернинг — метод обучения, где модель получает обратную связь в виде награды или штрафа за свои действия, как, например, при дрессировке собак. В данном случае это позволяет модели итеративно улучшать свои ответы, тренируясь на сложных задачах, таких как логические рассуждения, математика или программирование.

Основное отличие gpt-o1 от предыдущих версий заключается в том, что перед выдачей ответа пользователю она рассуждает шаг за шагом. Это позволяет ей разбивать сложные вопросы на составляющие и имитировать процесс человеческого мышления.

Это делает модели не просто инструментом для поиска информации, а полноценным помощником в решении сложных задач и открывает новые возможности для автоматизации процессов, требующих аналитического подхода, сближает ИИ с уровнем человеческого мышления.

А в декабре OpenAI представили gpt-o3 — следующую версию после o1

…пропустив o2 из-за совпадения с названием британского оператора сотовой связи.

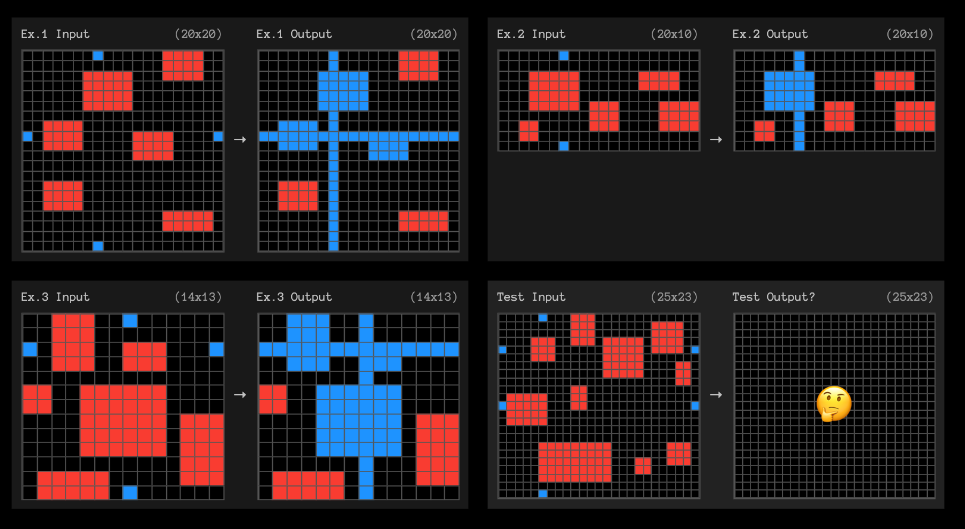

Главный инфоповод про o3 — это 88% в бенчмарке ARC-AGI. ARC-AGI — это набор тестов и задач, разработанных для оценки способности искусственного интеллекта к обобщению и адаптации к новым задачам. Что-то вроде IQ-теста, в котором содержатся задачи, которые всем людям даются легко, а у машин с ними возникают трудности.

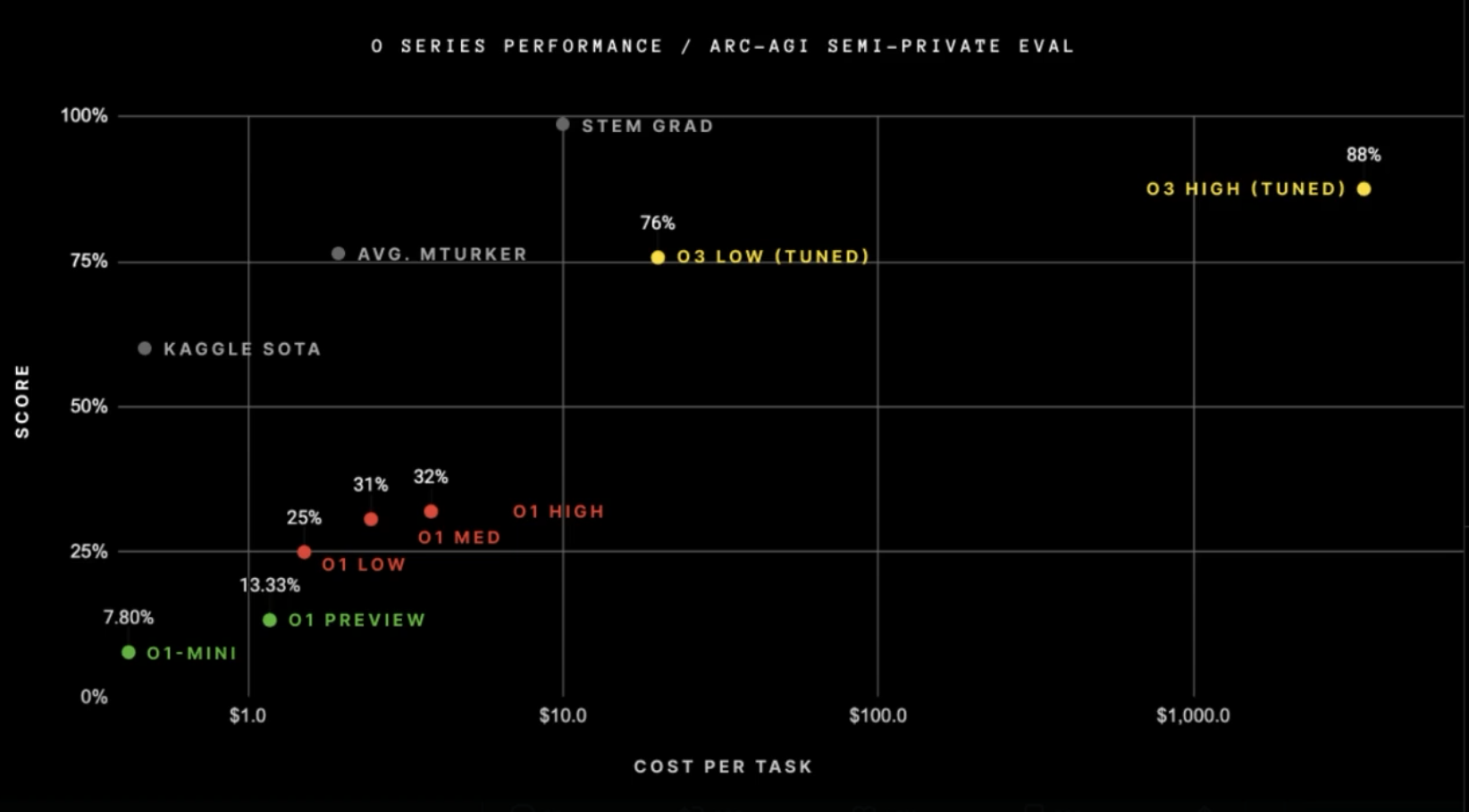

До версий с размышлением модельки OpenAI получали в бенчмарке около 1%, с o1 получилось добиться 32%, а с о3 — 88%.

При этом стоит отметить, что для получения результата 88% на вычислительные мощности для решения одной задачи OpenAI тратит несколько тысяч долларов. Модели, которые не рассуждают последовательно, тратят на одну задачу меньше доллара.

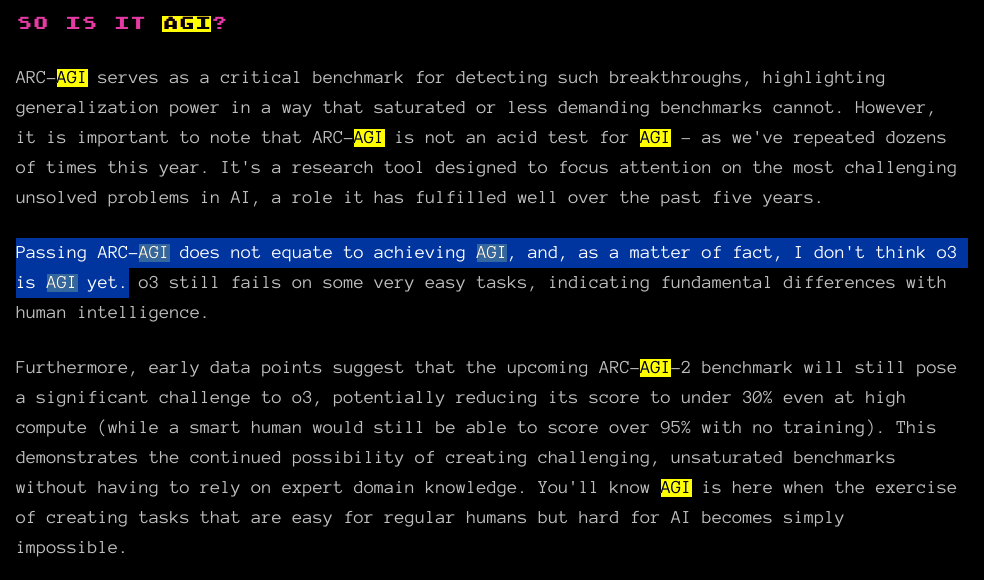

Многие в интернете начали заявлять, что искусственный интеллект достиг AGI, т.е. стал искусственным интеллектом общего назначения. Это название для ИИ, который, грубо говоря, имеет возможности человеческого мышления.

На это создатели бенчмарка ответили, что что их тесты не являются критерием достижения такого интеллекта. И сказали, что в 2025 году выпустят вторую версию бенчмарка с новыми задачами, в котором текущие результаты o3 будут оценены ниже 30% — вместо текущих 88.

Про другие бенчмарки говорят меньше, а они, на мой вкус, прямо сейчас полезнее и значат больше.

Во-первых, o3 стала решать задачи из SWE Bench на 20% лучше. SWE-bench — это набор данных, предназначенный для оценки способности языковых моделей решать реальные задачи разработки, взятые с GitHub. Он включает в себя две с лишним тысячи пар «задача-решение» из 12 популярных репозиториев.

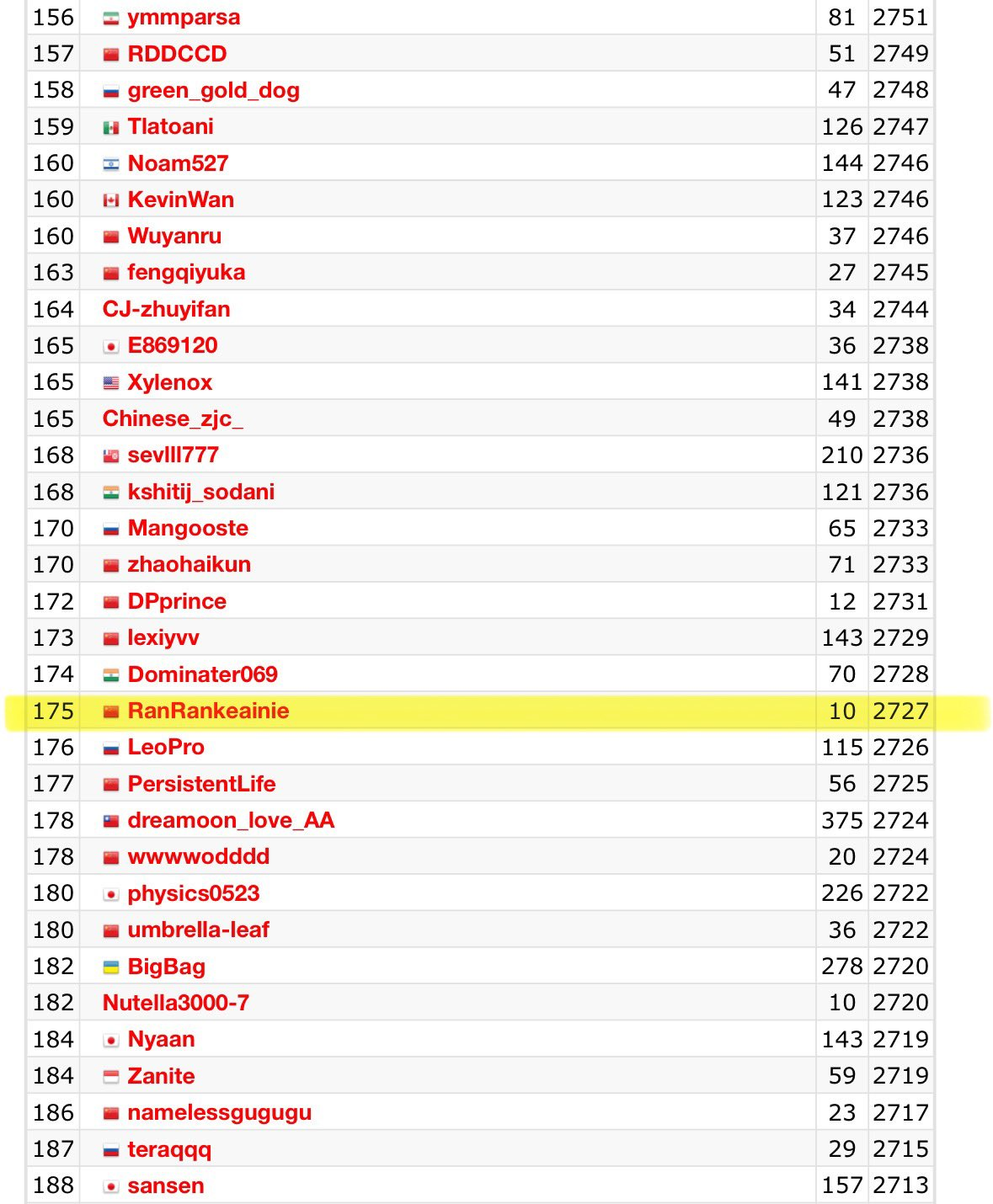

Во-вторых, o3 вошла в топ 175 соревновательных программистов по версии Codeforces, соперничая с реальными людьми.

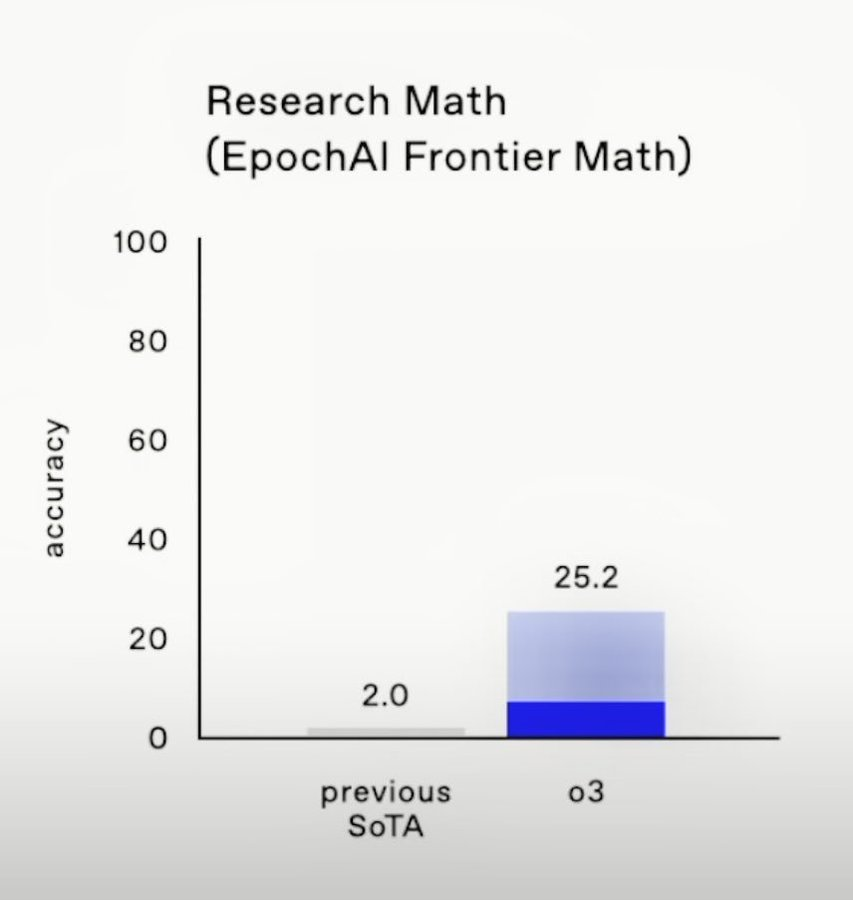

И набрала 25% в бенчмарке FrontierMath, где предыдущие модели получали до 2%. FrontierMath — это бенчмарк для оценки способности искусственного интеллекта решать сложные математические задачи.

Прогресс o3 впечатляет: модель продемонстрировала огромные успехи в сложных задачах. Тем не менее высокая стоимость вычислений и все еще ограниченный набор задач, на которых натренированы модели, показывают, что до полноценного AGI ещё далеко. Однако уже сейчас такие модели становятся мощными инструментами для решения реальных задач — от программирования до математики — и продолжают задавать новый стандарт в развитии искусственного интеллекта.

Про генерацию видео

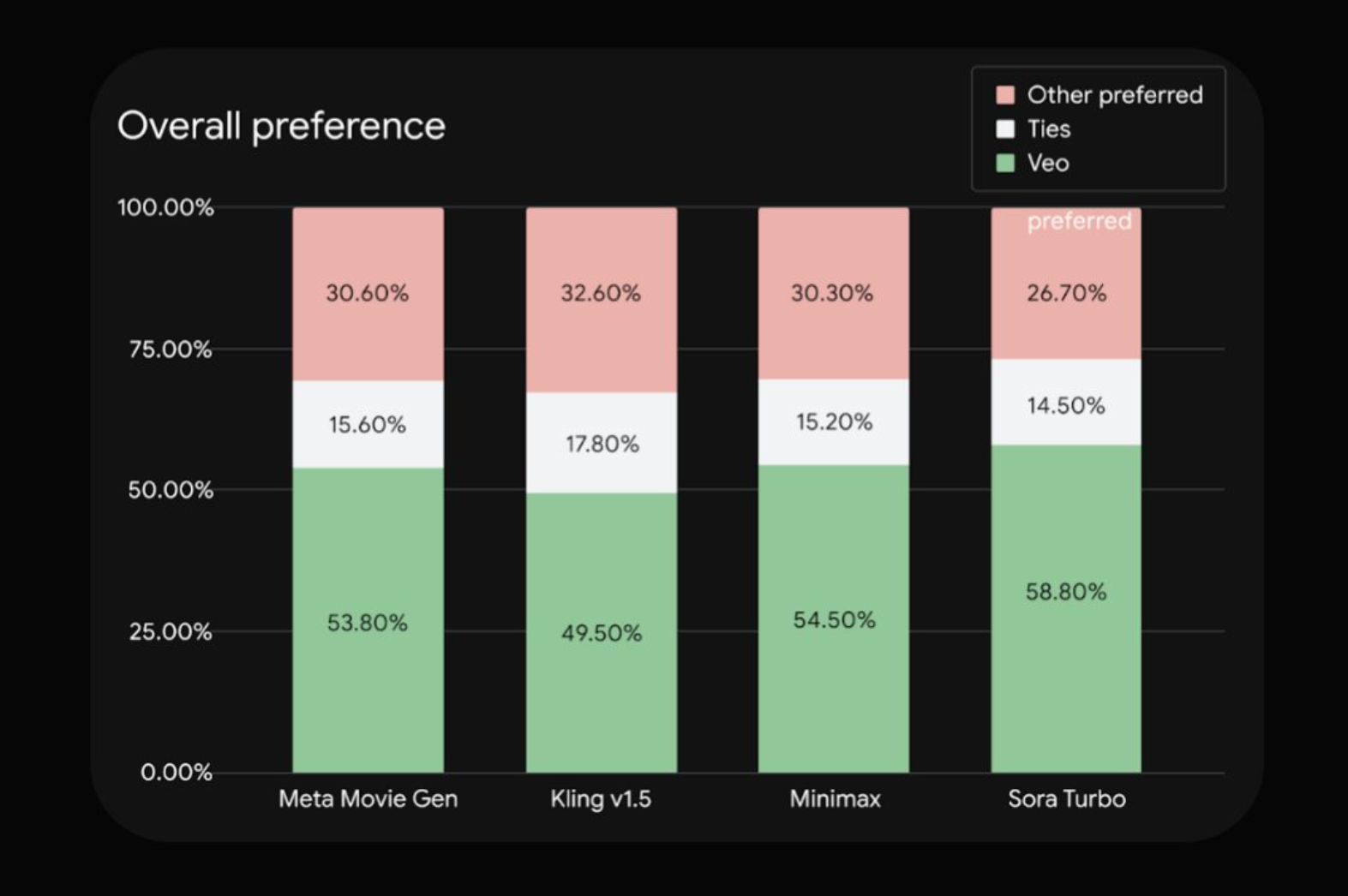

В декабре OpenAI и Google выпустили свои модели для генерации видео: Sora и Veo 2. Все вроде говорят про Sora, а Veo 2 оказался значительно лучше, особенно в сценах с физикой движения людей и животных.

Примеры сравнения:

-

https://www.reddit.com/r/singularity/comments/1hh7p0n/google_veo_2_vs_openai_sora/

-

https://www.youtube.com/watch?v=74J0uiZk29k&ab_channel=MarquesBrownlee

Google провел Side-by-Side тестирование с моделями конкурентов, т.е. случайным людям показывали промпт и результат работы двух моделей. Человек должен ответить, какое видео ему больше нравится или сказать, что оба норм. В итоге люди предпочитают модельку Google в 55% случаев, в 30% они выбирают модель конкурента, а в 15% они не могут определиться.

Видимо, доступ Google к своему YouTube дает им значительное преимущество при обучении.

Генерация видео еще далека от идеальной, в ближайшие год-два качество будет только расти, но я думаю, мы уже сейчас начнем видеть сгенерированные видео повсюду, как было с генерацией изображений в 2022–2023 годах.

Локальные большие языковые модели

Вернемся к языковым моделям.

Не все компании готовы отправлять свои данные в чужие облака. За этот год понавыходило много качественных моделей, которые можно развернуть локально. Многие из них отлично работают с русским языком.

Отметим Mistral NeMo и Qwen 2.5. Мы сами использовали их в работе и разворачивали нашим клиентам.

Например, мы делали «упрощатель юридических документов», используя Qwen, чтобы чувствительные данные не попадали в третьи руки.

Российские компании тоже делают LLMки: YandexGPT, GigaChat от Сбера. Также в декабре T-Lite и T-Pro от Т-банка выложили на huggingface (в январе у нас выйдет статья на Хабре, в которой мы посравниваем их с другими моделями). А Сбер выложил в опенсорс свой GigaChat Lite.

Локальные большие языковые модели становятся важной альтернативой облачным решениям, позволяя компаниям сохранять полный контроль над своими данными. Это особенно актуально для задач, связанных с конфиденциальной информацией, таких как юридические документы или внутренние системы. Развитие таких моделей делает технологии доступнее для бизнеса, обеспечивая гибкость и безопасность. Этот тренд продолжит развиваться, предлагая всё больше локальных решений, способных конкурировать с большими облачными моделями.

RAG

Поговорим о том, как все это используется в бизнесе. Одно из применений — это RAG. RAG расшифровывается как «извлечение и генерация» и работает в 2 этапа.

-

Извлечение: пользователь пишет вопрос, а система ищет релевантные данные во внешних источниках, например, в базе данных или в интернете.

-

Генерация: извлеченная на первом этапе информация передаются в языковую модель в качестве контекста вместе с вопросом пользователя и инструкцией, что с этим всем делать. Модель принимает вопрос, контекст и инструкцию и генерирует ответ на вопрос пользователя.

К началу 2024 года модельки стали мощнее, стали принимать на вход больше слов, что сильно подтолкнуло развитие и применение RAG.

В этом году мы сделали несколько таких систем, например:

-

Умный поиск по внутренним образовательным материалам компании. Система принимает от сотрудника запрос в свободной форме, находит материалы, передает их LLM, которая генерирует связный ответ для пользователя. Эту штуку мы делали в контуре клиента, используя опенсорсную Mistral NeMo.

-

Телеграм-бот Digital Guru, который ищет информацию в видеозаписях конференций и отвечает пользователю цитатами спикеров и ссылками на таймкоды этих цитат в видео.

Агенты

Дальнейшее развитие идеи RAG-ов — это агенты. Агент — это система, которая принимает на вход запрос от пользователя, затем сама выполняет какие-то действия во внешней среде: получает дополнительную информацию, через API выполняет действия в других сервисах, пишет и выполняет произвольный код для вычисления результатов, а в конце возвращает ответ пользователю.

Например, Google сделал агента, которого можно просить выполнять задачи в браузере. На демо они показали агенту Google-табличку с названиями компаний и попросили его найти их сайты и собрать email’ы. Агент пошел в Google, по очереди вбивал название сайта в поиск, находил на сайте страницу с контактами, находил email, а в конце выдал список собранных почт пользователю.

А мы сделали агента для техподдержки, который помимо ответа на вопросы может создавать задачи на основе сообщений об ошибках, запускать диагностику и генерировать индивидуальные промокоды для клиентов в качестве извинений. С помощью анализа сообщений он может определять настрой клиента и сам призвать живого оператора при необходимости.

Агенты выводят взаимодействие с ИИ на новый уровень, переходя от пассивных ответов к активным действиям. Они могут автоматизировать сложные процессы, такие как сбор информации, выполнение рутинных задач или управление внешними сервисами, что значительно упрощает работу как для пользователей, так и для бизнеса. Эти системы уже показывают себя полезными в самых разных областях: от автоматизации маркетинга и техподдержки до проведения аналитики и выполнения креативных задач.

А омнимодальные модели позволят агентам использовать текст, слух и зрение для выполнения более сложных задач.

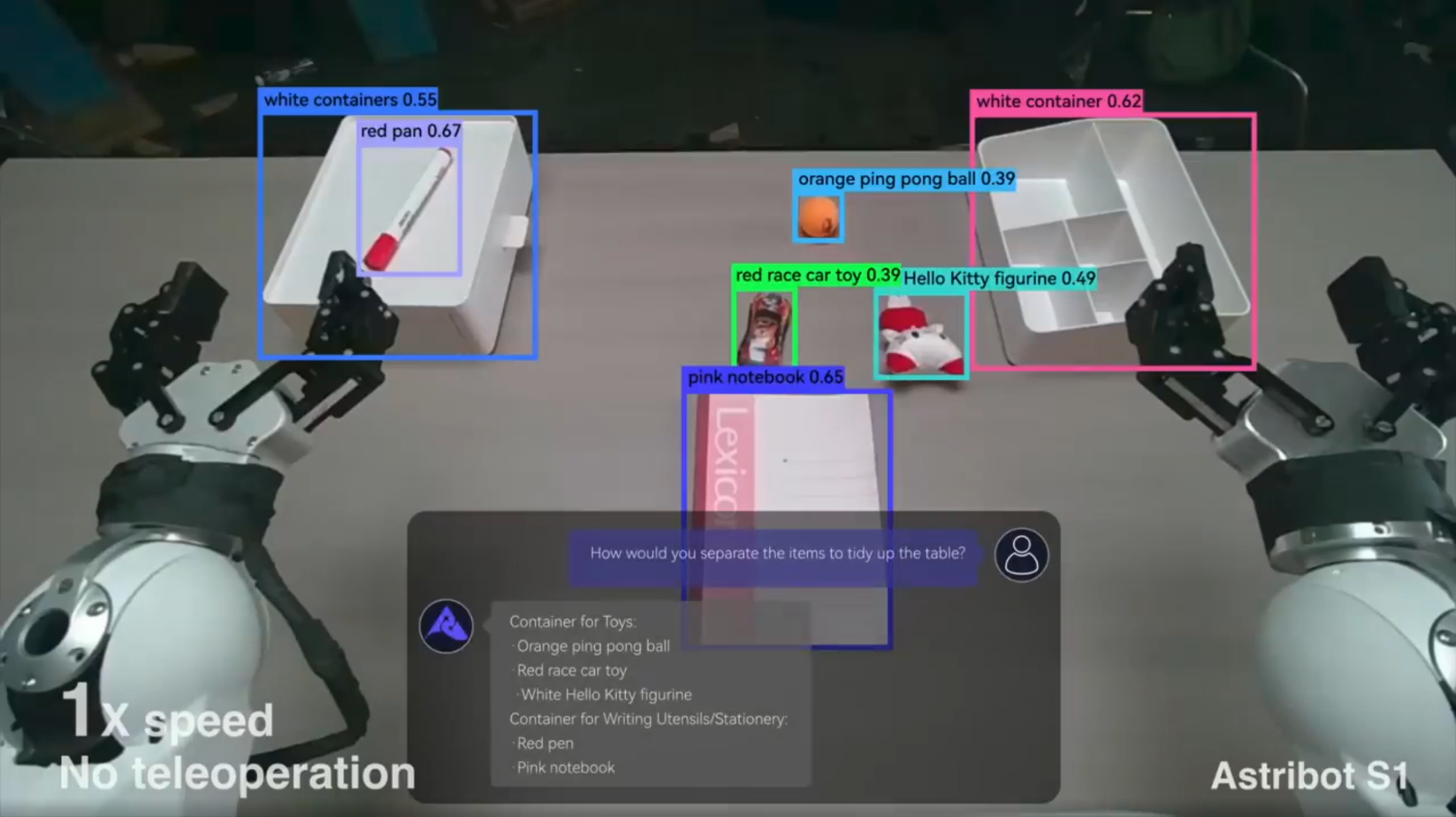

Роботы

Растет количество человекоподобных роботов общего назначения, управляемых искусственным интеллектом. Одни трудятся на заводах, другие помогают по дому. Особенно меня впечатлил китайский Astribot — он из тех, что помогают по дому. Примечателен тем, что использует LLM, чтобы анализировать то, что он видит и слышит, и принимать решения. В демке он с помощью зрения определяет объекты, а с помощью «размышлений» LLM разделяет их на 2 категории. Затем в зависимости от категории раскладывает их по двум контейнерам.

Вместе с тем, есть тренд на увеличение доступности робототехники, все интересующиеся могут попробовать себя в этой сфере с библиотекой LeRobot от huggingface. С ее помощью можно обучать роборуку.

Думаю, роботы уже скоро смогут быть очень похожими на людей, а благодаря LLM смогут понимать и проявлять эмоции, размышлять и совершать обдуманные действия.

Заключение

Все тренды, о которых я рассказал сегодня, начали активно развиваться в 2024 году, и очевидно, что они продолжат набирать обороты в 2025-м. Искусственный интеллект становится всё более универсальным, интегрируется в нашу повседневную жизнь и рабочие процессы, помогая решать задачи быстрее, проще и эффективнее.

Еще больше примеров применения можете посмотреть на сайте Doubletapp. А в блоге на Хабре можете найти статьи, в которых мы подробно рассказываем про техническую реализацию технологий машинного обучения.

Автор: raigfp0

Поговорим о трендах?

Поговорим о трендах?